DIAGRAMA DE FLUJO

Es un esquema para representar gráficamente un algoritmo. Se basan en la utilización de diversos símbolos para representar operaciones específicas, es decir, es la representación grafica de las distintas operaciones que se tienen que realizar para resolver un problema, con indicación expresa el orden lógico en que deben realizarse.

Ciencias de la Computación

martes, 24 de abril de 2012

Peseint

¿Qué es Pseint?

PSeInt es una herramienta para aprender la lógica de programación, orientada a estudiantes sin experiencia en dicha área. Mediante la utilización de un simple y limitado pseudo-lenguaje intuitivo y en español, permite comenzar a comprender conceptos básicos y fundamentales de un algoritmo computacional. Dejo un tutorial!

y la Descarga

http://ufpr.dl.sourceforge.net/project/pseint/20111106/pseint-w32-20111106.exe

PSeInt es una herramienta para aprender la lógica de programación, orientada a estudiantes sin experiencia en dicha área. Mediante la utilización de un simple y limitado pseudo-lenguaje intuitivo y en español, permite comenzar a comprender conceptos básicos y fundamentales de un algoritmo computacional. Dejo un tutorial!

y la Descarga

http://ufpr.dl.sourceforge.net/project/pseint/20111106/pseint-w32-20111106.exe

HEXADECIMAL

HEXADECIMAL

El sistema de numeración posicional de base 16 por lo cual tiene 16 símbolos. Su uso actual esta en la informática y ciencias de la computación, pues los computadores suelen utilizar el byte u octeto como unidad básica de memoria; a esto que un byte representa 28 valores posibles. Se utilizan dieciséis dígitos (0,1,2,3,4,5,6,7,8,9 y A,B,C,D,E,F) desde la A hasta la F se reemplazan a los números 10 hasta el 15 Esto seria así:

El sistema de numeración posicional de base 16 por lo cual tiene 16 símbolos. Su uso actual esta en la informática y ciencias de la computación, pues los computadores suelen utilizar el byte u octeto como unidad básica de memoria; a esto que un byte representa 28 valores posibles. Se utilizan dieciséis dígitos (0,1,2,3,4,5,6,7,8,9 y A,B,C,D,E,F) desde la A hasta la F se reemplazan a los números 10 hasta el 15 Esto seria así:

Decimal

|

Hexadecimal

|

0

|

0

|

1

|

1

|

2

|

2

|

3

|

3

|

4

|

4

|

5

|

5

|

6

|

6

|

7

|

7

|

8

|

8

|

9

|

9

|

10

|

A

|

11

|

B

|

12

|

C

|

13

|

D

|

14

|

E

|

15

|

F

|

Octal

El sistema de numeración octal utiliza ocho dígitos 0,1,2,3,4,5,6,7

Para convertir un número en base decimal a base octal se divide por 8 sucesivamente hasta llegar a cociente 0, y los restos de las divisiones en orden inverso indican el número en octal. Para pasar de base 8 a base decimal, solo hay que multiplicar cada cifra por 8 elevado a la posición de la cifra, y sumar el resultado.

En una cifra octal, cada dígito tiene distinto valor dependiendo de la posición que ocupe. El valor de cada posición es el de una potencia de base 8, elevada a un exponente igual a la posición del dígito menos uno.

El codigo octal es:

Aquí les dejo un conversor ! :)

Octal Conversion, Converting Decimal to Octal.

El codigo octal es:

0

|

00000

|

1

|

00001

|

2

|

00010

|

3

|

00011

|

4

|

00100

|

5

|

00101

|

6

|

00110

|

7

|

00111

|

Codigo Binario :)

¿Qué es el código binario?

Es la codificacion binaria de la informacion consiste en descomponerla en sus unidades elementales, es decir, convertirla en pregunta a las que solo es posible responder si o no. La representacion de cada dato exigira solo dos simbolos que se representaran por 1 y 0 En informática y telecomunicaciones, el código binario se utiliza con variados métodos de codificación de datos, tales como cadenas de caracteres, o cadenas de bits. Es muy utilizada en la informática, por ejemplo el disco rígido utiliza binarios y tu micro procesador es el encargado de transcodificarlo, es decir que tu microprocesador es un lector súper veloz de binarios.

Es la codificacion binaria de la informacion consiste en descomponerla en sus unidades elementales, es decir, convertirla en pregunta a las que solo es posible responder si o no. La representacion de cada dato exigira solo dos simbolos que se representaran por 1 y 0 En informática y telecomunicaciones, el código binario se utiliza con variados métodos de codificación de datos, tales como cadenas de caracteres, o cadenas de bits. Es muy utilizada en la informática, por ejemplo el disco rígido utiliza binarios y tu micro procesador es el encargado de transcodificarlo, es decir que tu microprocesador es un lector súper veloz de binarios.

¿Como funciona?

El codigo binario es la base de la informacion de las computadoras, es decir todo lo q veamos calculemos y realicemos en la computadora al final son llevadas a este codigo, consiste en dos unicos valores (el 0 y el 1), y mendiante la combinacion de ellos se representan la información. solo existen estos valores xq el cpu solo puede entender estas 2 instrucciones, (ausencia de corriente o presencia de ella). para contar en numero binario unicamente se le suma 1 como normalmente estamos acostumbrados, con la excepcion que si nos topamos con el caso de sumar 1+1 en ese digito se le coloca un 0 y tiene como acarreo 1 y asi sucesivamente.

p.e: 0011 ---------> 3 0001+ -------> 1 + 0100 = ------> 4 = El codigo binario es muy complejo, con estos cuatro digitos solo podremos representar una cantidad de 16 numeros (2^4; Dos elevado a la cuatro), ya que este es el numero de combinaciones distintas que se pueden hacer de 0 y 1.

por eso al momento de crear un programa en binario seria algo muy inhumano X( Para ello existen los lenguajes de alto nivel tales como java, c++, ruby, etc. en ellos se pueden programar de forma mas senilla que en binario y "El compilador" te muestra errores de codigos, tambien es el q lleva tu programa de alto nivel hacia uno en binario para que la computadora lo interpreta. para saber como funcionan te puedo dar un ejemplo de la representacion de los numero reales en binario. existe el formato llamado IEEE 754. este es un formato que puede aproximar un numero real casi a su exactitud. 1 01000010 00011100000000000000000 es un formato de 32 bits, (32 digitos en binario) lo cual el primer digito binario determina si el numero es positivo o negativo (0=positivo;1Negativo), los 8 digitos siguientes representan el exponente del numero, y los 23 restantes son la matisa.

y un vídeo para la conversión de decimal a binario :)

Un convertidor que encontré por ahí :)

Auspicio :http://profe-alexz.blogspot.com

Es la codificacion binaria de la informacion consiste en descomponerla en sus unidades elementales, es decir, convertirla en pregunta a las que solo es posible responder si o no. La representacion de cada dato exigira solo dos simbolos que se representaran por 1 y 0 En informática y telecomunicaciones, el código binario se utiliza con variados métodos de codificación de datos, tales como cadenas de caracteres, o cadenas de bits. Es muy utilizada en la informática, por ejemplo el disco rígido utiliza binarios y tu micro procesador es el encargado de transcodificarlo, es decir que tu microprocesador es un lector súper veloz de binarios.

Es la codificacion binaria de la informacion consiste en descomponerla en sus unidades elementales, es decir, convertirla en pregunta a las que solo es posible responder si o no. La representacion de cada dato exigira solo dos simbolos que se representaran por 1 y 0 En informática y telecomunicaciones, el código binario se utiliza con variados métodos de codificación de datos, tales como cadenas de caracteres, o cadenas de bits. Es muy utilizada en la informática, por ejemplo el disco rígido utiliza binarios y tu micro procesador es el encargado de transcodificarlo, es decir que tu microprocesador es un lector súper veloz de binarios.¿Como funciona?

El codigo binario es la base de la informacion de las computadoras, es decir todo lo q veamos calculemos y realicemos en la computadora al final son llevadas a este codigo, consiste en dos unicos valores (el 0 y el 1), y mendiante la combinacion de ellos se representan la información. solo existen estos valores xq el cpu solo puede entender estas 2 instrucciones, (ausencia de corriente o presencia de ella). para contar en numero binario unicamente se le suma 1 como normalmente estamos acostumbrados, con la excepcion que si nos topamos con el caso de sumar 1+1 en ese digito se le coloca un 0 y tiene como acarreo 1 y asi sucesivamente.

p.e: 0011 ---------> 3 0001+ -------> 1 + 0100 = ------> 4 = El codigo binario es muy complejo, con estos cuatro digitos solo podremos representar una cantidad de 16 numeros (2^4; Dos elevado a la cuatro), ya que este es el numero de combinaciones distintas que se pueden hacer de 0 y 1.

por eso al momento de crear un programa en binario seria algo muy inhumano X( Para ello existen los lenguajes de alto nivel tales como java, c++, ruby, etc. en ellos se pueden programar de forma mas senilla que en binario y "El compilador" te muestra errores de codigos, tambien es el q lleva tu programa de alto nivel hacia uno en binario para que la computadora lo interpreta. para saber como funcionan te puedo dar un ejemplo de la representacion de los numero reales en binario. existe el formato llamado IEEE 754. este es un formato que puede aproximar un numero real casi a su exactitud. 1 01000010 00011100000000000000000 es un formato de 32 bits, (32 digitos en binario) lo cual el primer digito binario determina si el numero es positivo o negativo (0=positivo;1Negativo), los 8 digitos siguientes representan el exponente del numero, y los 23 restantes son la matisa.

y un vídeo para la conversión de decimal a binario :)

Un convertidor que encontré por ahí :)

Auspicio :http://profe-alexz.blogspot.com

Todo comenzó... hace cientos de años atrás, cuando se creaban máquinas para ayudar en tareas de cálculos.

2500 a.c - El primer instrumento que usó el hombre para realizar un cálculo aparte de los dedos fue el ábaco. Consistía en un conjunto de cuentas colocadas en una varilla.

2000 a.C. - En el “I-Ching,” de origen chino, se encuentra la primera formulación del sistema binario.

600 a.C. - El astrónomo, matemático y filósofo griego Tales de Mileto describió algunos aspectos de la electricidadestática donde aparece la palabra “electrón”, usado para designar a las partículas negativas del átomo.

500 a.C. - Los romanos usaron ábacos con piedrecitas que eran desplazadas sobre una tabla con canales cifrados con sus números (I, V, X, L, C, D, M).

1300 d.C. - En China se inventa el ábaco que nosotros conocemos.

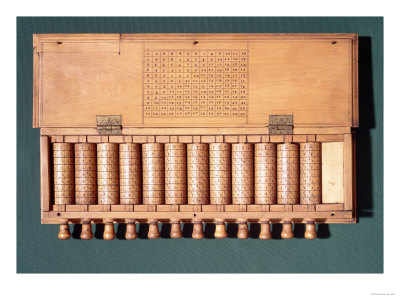

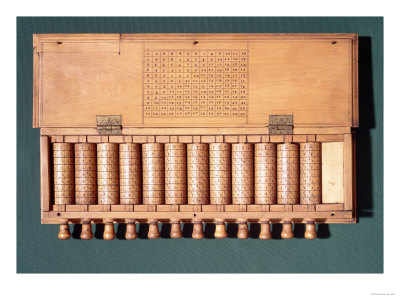

1617 – John Napier John Napier, un matemático Escocés, inventó los Huesos o Bastoncillos de Napier. Este artefacto permitía multiplicar grandes números mediante la manipulación de estos bastoncillos. John Napier

John Napier

1621 - William Oughtred El sacerdote inglés William Oughtred fue el primero en utilizar dos líneas de números que se desplazasen superpuestas y permitiesen realizar cálculos logarítmicos.

1623 - Wilhelm Schickard La primera calculadora mecánica fue creada en 1623 por Wilhelm Schickard, y Charles Babbage diseñó la máquina diferencial en la época victoriana. Todas máquinas que se limitaban a realizar una sola tarea, o como mucho, algún subconjunto de todas las posibles tareas.

Wilhelm Schickard

1642 – Blaise Pascal Blaise Pascal fue un matemático francés que nació en el 1623. Desde muy temprana edad era un entusiasta en el estudio autodidacta de las matemáticas. Antes de que alcanzara la edad de trece años, Pascal descubrió un error en la geometría de Descartes En el 1642 inventó una máquina calculadora que permitía sumar y restar, conocida como el Pascalino. Tal mecanismo, empleaba ruedas numeradas del 0 al 9, la cual incorporaba un mecanismo de dientes y cremalleras que permitían manejar números hasta 999,999.99. Debido al alto costo para reproducir este aparato, y porque la gente temía que fueran despedidas de sus trabajos, el Pascalino no fue un éxito comercial. Blaise Pascal

1671 - Gottfried Wilhelm Leibniz

Gottfried Wilhelm Leibniz Filósofo, matemático y estadista alemán. Diseñó una máquina capaz de realizar cálculos matemáticos siendo unas de las primeras de la historia. Una máquina multiplicadora.

1671 - Gottfried Wilhelm Leibniz

Gottfried Wilhelm Leibniz Filósofo, matemático y estadista alemán. Diseñó una máquina capaz de realizar cálculos matemáticos siendo unas de las primeras de la historia. Una máquina multiplicadora.

1834 - Charles Babbage Diseñó su “Máquina Analítica”, que operaba con más de 40 dígitos, pero nunca construyó, la máquina analítica para ejecutar programas de tabulación o computación; por estos inventos se le considera como una de las primeras personas en concebir la idea de lo que hoy llamaríamos una computadora.

1847 - George Boole

El británico George Boole desarrolló un nuevo tipo de álgebra (álgebra de Boole) e inició los estudios de lógica simbólica. En 1847 publicó "Elanálisis matemático del pensamiento" y en 1854 "Las leyes del pensamiento". Su álgebra era un método para resolver problemas de lógica por medio de los valores binarios (1 y 0) y tres operadores: and (y), or (o) y not (no). Por medio del álgebra binaria, posteriormente se desarrolló lo que hoy se conoce como código binario, que es el lenguaje utilizado por todas las computadoras.

1847 - George Boole

El británico George Boole desarrolló un nuevo tipo de álgebra (álgebra de Boole) e inició los estudios de lógica simbólica. En 1847 publicó "Elanálisis matemático del pensamiento" y en 1854 "Las leyes del pensamiento". Su álgebra era un método para resolver problemas de lógica por medio de los valores binarios (1 y 0) y tres operadores: and (y), or (o) y not (no). Por medio del álgebra binaria, posteriormente se desarrolló lo que hoy se conoce como código binario, que es el lenguaje utilizado por todas las computadoras.

1889 Se inventa la máquina calculadora con suma, resta, multiplicación y división, y que lentamente se empezó a producir de manera más masiva. Esta máquina solo podía realizar una operación a la vez y no tenía memoria.

1890 – Herman Hollerith Los cartones perforados y un primitivo aparato eléctrico se usaron para clasificar por sexo, edad y origen a la población de Estados Unidos. Estamáquina del censo fue facilitada por el ingeniero Herman Hollerith, cuya compañía posteriormente se fusionó (1924) con una pequeña empresade Nueva York, creando la International Business Machines (IBM), empresa que un siglo más tarde revolucionó el mercado con las computadoras personales o PC.

1893 – Entre 1893 y 1920, Leonardo Torres y Quevedo creó en España varias máquinas capaces de resolver operaciones algebraicas. Posteriormente construyó la primera máquina capaz de jugar ajedrez.

1920 – Se presentó en París el "aritmómetro electromecánico", que consistía en una calculadora conectada a una máquina de escribir, en la que se tecleaban los números y las operaciones. Una vez hecho el cálculo, la máquina entregaba automáticamente el resultado. Este aparato fue la primera versión de una calculadora digital.

1934-1939 - Konrad Suze Construyó en Alemania dos máquinas electromecánicas de cálculo que se acercaban bastante a lo que sería la primera computadora.

1937 - Claude Shannon Demostró que la programación de las futuras computadoras era más un problema de lógica que de aritmética, reconociendo la importancia del álgebra de Boole. Además, sugirió que podían usarse sistemas de conmutación como en las centrales telefónicas, idea que sería fundamental para la construcción de la primera computadora. Más adelante, junto con Warren Weaver, Shannon desarrolló la teoría matemática de la comunicación, hoy más conocida como la "teoría de la información", estableciendo los conceptos de negentropía, que se refiere a que la información reduce el desorden, y la unidad de medida del bit -en dígitos binarios- utilizada actualmente tanto en las telecomunicaciones como en la informática.

1939 - George Stibitz y S.B. Williams En Estados Unidos, George Stibitz y S.B. Williams, de los laboratorios Bell, construyeron una calculadora de secuencia automáticaque utilizaba interruptores ordinarios de sistemas de conmutación telefónica. Las nuevas y poderosas computadoras comenzaron a ser desarrolladas durante la década del 40, que es también cuando comenzó a hacerse evidente que las computadoras podían usarse para mucho más que simples cálculos matemáticos. 1941 - Konrad Suze En 1941, Konrad Suze presentó la Z3, la primera computadora electromagnética programable mediante una cinta perforada. Tenía dos mil electroimanes, una memoria de 64 palabras de 22 bits, pesaba mil kilos y consumía cuatro mil watts. Una adición demoraba 0,7 segundos, mientras que en una multiplicación o división tardaba 3 segundos.

1943 – Alan Turing Un equipo de expertos del ejército británico dirigido por Alan Turing construyó a Colossus, una computadora que permitía descifrar en pocos segundos y automáticamente los mensajes secretos de los nazis durante la Segunda Guerra Mundial, cifrados por la máquina Enigma.

1944 – Howard Aiken Graduado de física de la Universidad de Harvard, logró un convenio entre dicha universidad e IBM, por el que un grupo de graduados inició el diseño y la construcción de la primera computadora americana, del tipo electromecánico -basado en electroimanes-.

1949 – John Von Neumann El matemático húngaro John Von Neumann resolvió el problema de tener que cablear la máquina para cada tarea. La solución fue poner las instrucciones en la misma memoria que los datos, escribiéndolas de la misma forma, en código binario. Refiriéndose a esta innovación, se habla de la "arquitectura de Von Neumann". Su EDVAC fue el modelo de las computadoras de este tipo.

1957 – Fortran Un equipo de IBM, dirigido por John Backus, creó el primer lenguaje de programación, llamado Fortran, formulado para el IBM 704. 60’s - Técnicos de varios laboratorios, a partir de la elaboración de los transistores, comenzaron a producir unidades más grandes con múltiples componentes que cumplían diversas funciones electrónicas. Se trataba de los circuitos integrados o chips. Estos permitieron una nueva disminución en el tamaño y el costo.

1969 - Kenneth Thompson y Dennis Ritchie Kenneth Thompson y Dennis Ritchie, de Bell Labs, desarrollaron el sistema operativo Unix. 1971 – Intel La compañía Intel lanzó el primer microprocesador, el Intel 4004, un pequeño chip de silicio. Se trató de un circuito integrado especialmente construido para efectuar las operaciones básicas de Babbage y conforme a la arquitectura de Von Neumann. Fue la primera Unidad Central de Procesos (CPU). La integración de estos procesos avanzó en distintas etapas: • Integración simple (Integrated Circuits o IC) • Alta integración (Large Scale Integration o LSI) • Muy alta integración (Very Large Scale Integration o VLSI) Estos procesos permitieron acelerar el funcionamiento de las computadoras, logrando superar el millón de operaciones por segundo.

1971 - Alan Shugart Alan Shugart De IBM, inventó el disco flexible o floppy disk, un disquete de 5 1/4 pulgadas.

1974 – Surge el Altair 8800, la primera computadora de escritorio, comercializada con el microprocesador Intel 8080. Aunque no incluía teclado, monitor, ni software de aplicación, esta máquina dió inicio a una revolución en los sistemas computacionales modernos.

1975 - Steve Jobs -que trabajaba en Atari- y Steven Wozniak -ingeniero de Hewlett Packard- se juntaron para armar una microcomputadora que pudiera ser usada más masivamente. Wozniak diseñó una placa única capaz de soportar todos los componentes esenciales y desarrolló el lenguaje de programación Basic. El resultado fue la primera computadora Apple. Steve Jobs y Steven Wozniak, crearon la primera computadora Apple. Steve Jobs, y la primera computadora Apple A fines de 1976 tenían el modelo listo para ser comercializado: el Apple II. Tras varios intentos, finalmente consiguieron el apoyo de Mike Markulla, con quien formaron su propia compañía, la Apple Computers. El Apple II siguió fabricándose por otros quince años, todo un récor para una industriaque continuamente presenta novedades.

1975 - Bill Gates y Paul Allen se unen para crear Microsoft, una empresa dedicada integramente al "software" La masificación de la computación llegó de la mano de las computadoras personales a principios de los 80, y el acceso a la información mundial de la mano de internet, que comenzó su éxito en los 90.

1981 – Tras el éxito de la microcomputadora, en 1981 IBM lanzó al mercado el IBM PC, diseñado por doce ingenieros dirigidos por William C. Lowe. Su principal característica es que tenía una estructura abierta; es decir, que era capaz de integrar componentes de otros fabricantes. De hecho, su sistema operativo, el DOS 1.0, era de Microsoft, y el microprocesador, un Intel 8088.

1984 – En 1984, la compañía Apple presentó una nueva computadora, la Macintosh, sucesora de un modelo denominado Lisa. Entre sus novedades estaba la incorporación de una herramienta nueva para controlar la computadora, el mouse o ratón. El modelo no tuvo gran aceptación, debido a su alto costo.

1985 - En 1985, Microsoft -compañía fundada por Bill Gates y Paul Allen en 1975- presentó el software Windows 1.1 Ese mismo año aparecen los primeros CD-ROM para computadoras. Las computadoras personales surgieron gracias a la Muy Alta Integración de sus procesos (VLSI) desarrollada durante los ochentas, y que permitió concentrar miles de componentes electrónicos en una plaquita de silicio (el chip) de alrededor de un centímetro cuadrado. Esto ha permitido reducir los tamaños de estas máquinas hasta hacerlas portátiles (Notebooks) y ampliar su velocidad por sobre el billón de operaciones por segundo, como es el caso de los supercomputadoras.

1990 - Durante los noventa comenzó a masificarse el uso de las computadoras, al disminuir su tamaño y también su costo, debido a la producción en serie y a la competencia entre las fabricantes IBM, Apple y Microsoft. Primero se multiplicaron en las empresas y luego fueron apareciendo cada vez en más hogares.

1993 - Lanzamiento de Pentium.

1995 – Lanzamiento de Windows 95. La Microsoft desarrolla MSN

1995 - MP1-2-3-4: Tecnologías de compresión que usan algunos formatos de audio y video.

1996 El USB es una interfaz que provee un Estándar de Bus Serie para conectar dispositivos a un ordenador personal. Desarrollado por : IBM, Intel Northern Telecom, Compaq, Microsoft, Digital Equipment Corporation y NEC

1999 AMD es lanzado en la versión K6-lil de 400MHz.

2000 Microsoft, es enjuiciada por monopolio. Se lanza el microprocesador Pentium III

2001- Microsoft, saca al Mercado el Microprocesador Pentium IV

2002 - Lanzamiento de un buscador de productos y compra de Blogger.

2004 - Presentación de Gmail. Acuerdo con bibliotecas para escanear libros y ofrecerlos en versión digita

2500 a.c - El primer instrumento que usó el hombre para realizar un cálculo aparte de los dedos fue el ábaco. Consistía en un conjunto de cuentas colocadas en una varilla.

2000 a.C. - En el “I-Ching,” de origen chino, se encuentra la primera formulación del sistema binario.

600 a.C. - El astrónomo, matemático y filósofo griego Tales de Mileto describió algunos aspectos de la electricidadestática donde aparece la palabra “electrón”, usado para designar a las partículas negativas del átomo.

500 a.C. - Los romanos usaron ábacos con piedrecitas que eran desplazadas sobre una tabla con canales cifrados con sus números (I, V, X, L, C, D, M).

1300 d.C. - En China se inventa el ábaco que nosotros conocemos.

1617 – John Napier John Napier, un matemático Escocés, inventó los Huesos o Bastoncillos de Napier. Este artefacto permitía multiplicar grandes números mediante la manipulación de estos bastoncillos.

John Napier

John Napier1621 - William Oughtred El sacerdote inglés William Oughtred fue el primero en utilizar dos líneas de números que se desplazasen superpuestas y permitiesen realizar cálculos logarítmicos.

1623 - Wilhelm Schickard La primera calculadora mecánica fue creada en 1623 por Wilhelm Schickard, y Charles Babbage diseñó la máquina diferencial en la época victoriana. Todas máquinas que se limitaban a realizar una sola tarea, o como mucho, algún subconjunto de todas las posibles tareas.

Wilhelm Schickard

1642 – Blaise Pascal Blaise Pascal fue un matemático francés que nació en el 1623. Desde muy temprana edad era un entusiasta en el estudio autodidacta de las matemáticas. Antes de que alcanzara la edad de trece años, Pascal descubrió un error en la geometría de Descartes En el 1642 inventó una máquina calculadora que permitía sumar y restar, conocida como el Pascalino. Tal mecanismo, empleaba ruedas numeradas del 0 al 9, la cual incorporaba un mecanismo de dientes y cremalleras que permitían manejar números hasta 999,999.99. Debido al alto costo para reproducir este aparato, y porque la gente temía que fueran despedidas de sus trabajos, el Pascalino no fue un éxito comercial. Blaise Pascal

1671 - Gottfried Wilhelm Leibniz

Gottfried Wilhelm Leibniz Filósofo, matemático y estadista alemán. Diseñó una máquina capaz de realizar cálculos matemáticos siendo unas de las primeras de la historia. Una máquina multiplicadora.

1671 - Gottfried Wilhelm Leibniz

Gottfried Wilhelm Leibniz Filósofo, matemático y estadista alemán. Diseñó una máquina capaz de realizar cálculos matemáticos siendo unas de las primeras de la historia. Una máquina multiplicadora.

1834 - Charles Babbage Diseñó su “Máquina Analítica”, que operaba con más de 40 dígitos, pero nunca construyó, la máquina analítica para ejecutar programas de tabulación o computación; por estos inventos se le considera como una de las primeras personas en concebir la idea de lo que hoy llamaríamos una computadora.

1847 - George Boole

El británico George Boole desarrolló un nuevo tipo de álgebra (álgebra de Boole) e inició los estudios de lógica simbólica. En 1847 publicó "Elanálisis matemático del pensamiento" y en 1854 "Las leyes del pensamiento". Su álgebra era un método para resolver problemas de lógica por medio de los valores binarios (1 y 0) y tres operadores: and (y), or (o) y not (no). Por medio del álgebra binaria, posteriormente se desarrolló lo que hoy se conoce como código binario, que es el lenguaje utilizado por todas las computadoras.

1847 - George Boole

El británico George Boole desarrolló un nuevo tipo de álgebra (álgebra de Boole) e inició los estudios de lógica simbólica. En 1847 publicó "Elanálisis matemático del pensamiento" y en 1854 "Las leyes del pensamiento". Su álgebra era un método para resolver problemas de lógica por medio de los valores binarios (1 y 0) y tres operadores: and (y), or (o) y not (no). Por medio del álgebra binaria, posteriormente se desarrolló lo que hoy se conoce como código binario, que es el lenguaje utilizado por todas las computadoras.

1889 Se inventa la máquina calculadora con suma, resta, multiplicación y división, y que lentamente se empezó a producir de manera más masiva. Esta máquina solo podía realizar una operación a la vez y no tenía memoria.

1890 – Herman Hollerith Los cartones perforados y un primitivo aparato eléctrico se usaron para clasificar por sexo, edad y origen a la población de Estados Unidos. Estamáquina del censo fue facilitada por el ingeniero Herman Hollerith, cuya compañía posteriormente se fusionó (1924) con una pequeña empresade Nueva York, creando la International Business Machines (IBM), empresa que un siglo más tarde revolucionó el mercado con las computadoras personales o PC.

1893 – Entre 1893 y 1920, Leonardo Torres y Quevedo creó en España varias máquinas capaces de resolver operaciones algebraicas. Posteriormente construyó la primera máquina capaz de jugar ajedrez.

1920 – Se presentó en París el "aritmómetro electromecánico", que consistía en una calculadora conectada a una máquina de escribir, en la que se tecleaban los números y las operaciones. Una vez hecho el cálculo, la máquina entregaba automáticamente el resultado. Este aparato fue la primera versión de una calculadora digital.

1934-1939 - Konrad Suze Construyó en Alemania dos máquinas electromecánicas de cálculo que se acercaban bastante a lo que sería la primera computadora.

1937 - Claude Shannon Demostró que la programación de las futuras computadoras era más un problema de lógica que de aritmética, reconociendo la importancia del álgebra de Boole. Además, sugirió que podían usarse sistemas de conmutación como en las centrales telefónicas, idea que sería fundamental para la construcción de la primera computadora. Más adelante, junto con Warren Weaver, Shannon desarrolló la teoría matemática de la comunicación, hoy más conocida como la "teoría de la información", estableciendo los conceptos de negentropía, que se refiere a que la información reduce el desorden, y la unidad de medida del bit -en dígitos binarios- utilizada actualmente tanto en las telecomunicaciones como en la informática.

1939 - George Stibitz y S.B. Williams En Estados Unidos, George Stibitz y S.B. Williams, de los laboratorios Bell, construyeron una calculadora de secuencia automáticaque utilizaba interruptores ordinarios de sistemas de conmutación telefónica. Las nuevas y poderosas computadoras comenzaron a ser desarrolladas durante la década del 40, que es también cuando comenzó a hacerse evidente que las computadoras podían usarse para mucho más que simples cálculos matemáticos. 1941 - Konrad Suze En 1941, Konrad Suze presentó la Z3, la primera computadora electromagnética programable mediante una cinta perforada. Tenía dos mil electroimanes, una memoria de 64 palabras de 22 bits, pesaba mil kilos y consumía cuatro mil watts. Una adición demoraba 0,7 segundos, mientras que en una multiplicación o división tardaba 3 segundos.

1943 – Alan Turing Un equipo de expertos del ejército británico dirigido por Alan Turing construyó a Colossus, una computadora que permitía descifrar en pocos segundos y automáticamente los mensajes secretos de los nazis durante la Segunda Guerra Mundial, cifrados por la máquina Enigma.

1944 – Howard Aiken Graduado de física de la Universidad de Harvard, logró un convenio entre dicha universidad e IBM, por el que un grupo de graduados inició el diseño y la construcción de la primera computadora americana, del tipo electromecánico -basado en electroimanes-.

1949 – John Von Neumann El matemático húngaro John Von Neumann resolvió el problema de tener que cablear la máquina para cada tarea. La solución fue poner las instrucciones en la misma memoria que los datos, escribiéndolas de la misma forma, en código binario. Refiriéndose a esta innovación, se habla de la "arquitectura de Von Neumann". Su EDVAC fue el modelo de las computadoras de este tipo.

1957 – Fortran Un equipo de IBM, dirigido por John Backus, creó el primer lenguaje de programación, llamado Fortran, formulado para el IBM 704. 60’s - Técnicos de varios laboratorios, a partir de la elaboración de los transistores, comenzaron a producir unidades más grandes con múltiples componentes que cumplían diversas funciones electrónicas. Se trataba de los circuitos integrados o chips. Estos permitieron una nueva disminución en el tamaño y el costo.

1969 - Kenneth Thompson y Dennis Ritchie Kenneth Thompson y Dennis Ritchie, de Bell Labs, desarrollaron el sistema operativo Unix. 1971 – Intel La compañía Intel lanzó el primer microprocesador, el Intel 4004, un pequeño chip de silicio. Se trató de un circuito integrado especialmente construido para efectuar las operaciones básicas de Babbage y conforme a la arquitectura de Von Neumann. Fue la primera Unidad Central de Procesos (CPU). La integración de estos procesos avanzó en distintas etapas: • Integración simple (Integrated Circuits o IC) • Alta integración (Large Scale Integration o LSI) • Muy alta integración (Very Large Scale Integration o VLSI) Estos procesos permitieron acelerar el funcionamiento de las computadoras, logrando superar el millón de operaciones por segundo.

1971 - Alan Shugart Alan Shugart De IBM, inventó el disco flexible o floppy disk, un disquete de 5 1/4 pulgadas.

1974 – Surge el Altair 8800, la primera computadora de escritorio, comercializada con el microprocesador Intel 8080. Aunque no incluía teclado, monitor, ni software de aplicación, esta máquina dió inicio a una revolución en los sistemas computacionales modernos.

1975 - Steve Jobs -que trabajaba en Atari- y Steven Wozniak -ingeniero de Hewlett Packard- se juntaron para armar una microcomputadora que pudiera ser usada más masivamente. Wozniak diseñó una placa única capaz de soportar todos los componentes esenciales y desarrolló el lenguaje de programación Basic. El resultado fue la primera computadora Apple. Steve Jobs y Steven Wozniak, crearon la primera computadora Apple. Steve Jobs, y la primera computadora Apple A fines de 1976 tenían el modelo listo para ser comercializado: el Apple II. Tras varios intentos, finalmente consiguieron el apoyo de Mike Markulla, con quien formaron su propia compañía, la Apple Computers. El Apple II siguió fabricándose por otros quince años, todo un récor para una industriaque continuamente presenta novedades.

1975 - Bill Gates y Paul Allen se unen para crear Microsoft, una empresa dedicada integramente al "software" La masificación de la computación llegó de la mano de las computadoras personales a principios de los 80, y el acceso a la información mundial de la mano de internet, que comenzó su éxito en los 90.

1981 – Tras el éxito de la microcomputadora, en 1981 IBM lanzó al mercado el IBM PC, diseñado por doce ingenieros dirigidos por William C. Lowe. Su principal característica es que tenía una estructura abierta; es decir, que era capaz de integrar componentes de otros fabricantes. De hecho, su sistema operativo, el DOS 1.0, era de Microsoft, y el microprocesador, un Intel 8088.

1984 – En 1984, la compañía Apple presentó una nueva computadora, la Macintosh, sucesora de un modelo denominado Lisa. Entre sus novedades estaba la incorporación de una herramienta nueva para controlar la computadora, el mouse o ratón. El modelo no tuvo gran aceptación, debido a su alto costo.

1985 - En 1985, Microsoft -compañía fundada por Bill Gates y Paul Allen en 1975- presentó el software Windows 1.1 Ese mismo año aparecen los primeros CD-ROM para computadoras. Las computadoras personales surgieron gracias a la Muy Alta Integración de sus procesos (VLSI) desarrollada durante los ochentas, y que permitió concentrar miles de componentes electrónicos en una plaquita de silicio (el chip) de alrededor de un centímetro cuadrado. Esto ha permitido reducir los tamaños de estas máquinas hasta hacerlas portátiles (Notebooks) y ampliar su velocidad por sobre el billón de operaciones por segundo, como es el caso de los supercomputadoras.

1990 - Durante los noventa comenzó a masificarse el uso de las computadoras, al disminuir su tamaño y también su costo, debido a la producción en serie y a la competencia entre las fabricantes IBM, Apple y Microsoft. Primero se multiplicaron en las empresas y luego fueron apareciendo cada vez en más hogares.

1993 - Lanzamiento de Pentium.

1995 – Lanzamiento de Windows 95. La Microsoft desarrolla MSN

1995 - MP1-2-3-4: Tecnologías de compresión que usan algunos formatos de audio y video.

1996 El USB es una interfaz que provee un Estándar de Bus Serie para conectar dispositivos a un ordenador personal. Desarrollado por : IBM, Intel Northern Telecom, Compaq, Microsoft, Digital Equipment Corporation y NEC

1999 AMD es lanzado en la versión K6-lil de 400MHz.

2000 Microsoft, es enjuiciada por monopolio. Se lanza el microprocesador Pentium III

2001- Microsoft, saca al Mercado el Microprocesador Pentium IV

2002 - Lanzamiento de un buscador de productos y compra de Blogger.

2004 - Presentación de Gmail. Acuerdo con bibliotecas para escanear libros y ofrecerlos en versión digita

domingo, 15 de abril de 2012

Conceptos básicos de la Computación

100 importantes términos en cuanto a la computación!

¿Qué es un computador?

Un computador es una máquina capaz de recibir instrucciones a través de algún medio, entenderlas y finalmente ejecutarlas.

Para que un computador pueda ejecutar alguna instrucción, primero ésta debe entregársela por algún medio físico y codificado en algún lenguaje entendible por el computador. Si la orden está dada en forma correcta y si el computador cuenta con los medios necesarios para ejecutarla, lo hará.

No se puede pensar que un computador sea capaz de realizar cualquiera tarea que se le ordene.

¿Qué es un programa?

Como vimos en el punto anterior, un computador necesita de un conjunto de instrucciones para que pueda funcionar y realizar las tareas que se requiera. Estas instrucciones son entregadas a través de un Programa.

Un programa es un conjunto de instrucciones escritas en algún lenguaje entendible por la máquina. A través de los programas el computador puede realizar variadas operaciones, desde procesar textos y dibujos hasta resolver complejos problemas matemáticos.

1. Algoritmo: conjunto de reglas bien

definidas para la resolución de un problema. Un programa de software es la

transcripción, en lenguaje de programación, de un algoritmo.

2. Antivirus: programa que busca y

eventualmente elimina losn virus informáticos que pueden haber infectado un

disco rígido o disquete.

3. Arbol (tree): estructura de datos en la

cual los registros son almacenados de manera jerárquica.

4. ASCII (American Standard Code for

Information Interchange, Código americano Normado para el Intercambio de

Información): Conjunto de caracteres, letras y símbolos utilizados en todos los

sistemas de computadoras de cualquier país e idioma. Permite una base común de

comunicación. Incluye a las letras normales de alfabeto español, con excepción

de la ñ y toda letra acentuada.

5. AVI: formato de Microsoft para archivos

de audio y video.

6. Back-end processor: procesador que se

utiliza para determinada función muy especializada, como por ejemplo,

administrar una base de datos.

7. Backup: copia de seguridad. Se hace para

prevenir una posible pérdida de información.

8. Backdoor (o trapdoor, puerta trasera o

puerta trampa): Sección oculta de un programa de computadora, que sólo se pone

en funcionamiento si se dan condiciones o circunstancias muy particulares en el

programa.

9. BIOS: Basic Input/Output System: Sistema

básico de ingreso/salida de datos. Conjunto de procedimientos que controla el

flujo de datos entre el sistema operativo y dispositivos tales como el disco

rígido, la placa de video, el teclado, el mouse y la impresora.

10. Bit: abreviatura de binary digit (dígito

binario). El bit es la unidad más pequeña de almacenamiento en un sistema

binario dentro de una computadora.

11. Boot (butear): cargar el sistema

operativo de una computadora.

12. Bps: bits por segundo.

13. Bridge: Dispositivo usado para conectar

dos redes y hacer que las mismas funcionen como si fueran una.

14. Buffer: área de la memoria que se

utiliza para almacenar datos temporariamente durante una sesión de trabajo.

15. Byte: unidad de información utilizada

por las computadoras. Cada byte está compuesto por ocho bits.

16. Caché de disco: pequeña porción de

memoria RAM que almacena datos recientemente leídos, con lo cual agiliza el

acceso futuro a los mismos datos.

17. CD-ROM: Compact

Disk - Read Only Memory. Disco compacto de sólo lectura. Tiene una capacidad de

almacenamiento de hasta 650 megabytes, mucho mayor que la de un disquete.

18. Chip: abreviatura de

"microchip". Circuito muy pequeño, compuesto por miles a millones de

transistores impresos sobre una oblea de silicio.

19. Chipset: Conjunto de circuitos

integrados diseñados en base a la arquitectura de un procesador permitiendo

que ese tipo de procesadores funcionen en una placa base. Sirven de

puente de comunicación con el resto de componentes de la Motherboard, como son la memoria, las tarjetas

de expansión, los puertos USB, Mouse, sonido, teclado, entre

otros.

20. Cookie: pequeño archivo de texto que un

sitio web coloca en el disco rígido de una computadora que lo visita. Al mismo

tiempo, recoge información sobre el usuario. Agiliza la navegación en el sitio.

Su uso es controvertido, porque pone en riesgo la privacidad de los usuarios.

21. CPU: Central Processing Unit. Unidad

central de procesamiento. Es el procesador que contiene los circuitos lógicos

que realizan las instrucciones de la computadora.

22. CRT: Cathode Ray Tube. Tubo de rayos

catódicos de un monitor, presente en la mayoría de las computadoras de

escritorio.

23. DSL (Línea Digital de Suscripción):

Tecnología que permite enviar mucha información a gran velocidad a través de

líneas telefónicas.

24. DVD (Disco Versátil Digital): Disco que

posee gran capacidad de almacenamiento y sirve también para almacenar películas.

25. Dynamic HTML: variante del HTML (Hyper

TextMark-up Language) que permite crear páginas web más animadas.

26. Encriptar: proteger archivos expresando

su contenido en un lenguaje cifrado. Los lenguajes cifrados simples consisten,

por ejemplo, en la sustitución de letras por números.

27. Fast Ethernet: Un nuevo estándar de

Ethernet que provee velocidad de 100 Megabits por segundo ( a diferencia de los

10 megabits por segundo de las redes Ethernet ).

28. FDDI ( Fiber Distributed Data

Interface): Interfaz de datos distribuidos por fibra óptica. Se trata de una

red de 100 Megabits por segundo en topología en estrella o anillo muy utilizada

en backbones, hoy desplazada por nuevas tecnologías como ATM.

29. Firewall: Una computadora que corre un

software especial utilizado para prevenir el acceso de usuarios no autorizados

a la red. Todo el tráfico de la red debe pasar primero a través de la

computadora del firewall.

30. FTP (File Transfer Protocol): protocolo

de Transferencia de Archivos. Sirve para enviar y recibir archivos de Internet.

31. Giga: prefijo que indica un múltiplo de

1.000 millones, o sea 109. Cuando se emplea el sistema binario, como ocurre en

informática, significa un múltiplo de 230, o sea 1.073.741.824.

32. Gigabit: Aproximadamente 1.000 millones

de bits (exactamente 1.073.741.824 bits)

33. Gigabyte (GB): unidad de medida de una

memoria. 1 gigabyte = 1024 megabytes = 1.073.741.824 bytes.

34. Hardware: todos los componentes físicos

de la computadora y sus periféricos.

35. Hertz: Hercio.Unidad de frecuencia

electromagnética. Equivale a un ciclo por segundo.

36. HTML: Hyper Text

Mark-up Language. Lenguaje de

programación para armar páginas web.

37. HTTP: Hypertext Transfer Protocol.

Protocolo de transferencia de hipertextos. Es un protocolo que permite

transferir información en archivos de texto, gráficos, de video, de audio y

otros recursos multimedia.

38. Interfase: Elemento de transición o

conexión que facilita el intercambio de datos. El teclado, por ejemplo, es una

interfase entre el usuario y la computadora.

39. IP: Protocolo de Internet.

40. IrDA (Infrared Data Association): Organización

fundada para crear las normas internacionales para el hardware y el software

usados en enlaces de comunicación por rayos infrarrojos.

41. ISO:

International Organization for Standardization. Fundada en 1946, es una federación internacional que

unifica normas en unos cien países. Una de ellas es la norma OSI, modelo de

referencia universal para protocolos de comunicación.

42. ISP: Proveedor de servicios de Internet.

43. Jpeg: extensión de ciertos archivos

gráficos.

44. kernel: núcleo o parte esencial de un

sistema operativo. Provee los servicios básicos del resto del sistema.

45. kilobit: 1.024 bits.

46. Kbps: Kilobits por segundo.

47. kilobyte (KB): unidad de medida de una

memoria. l kilobyte = 1024 bytes.

48. LAN: Local Area Network o red de área

local: Se trata de una red de comunicación de datos geográficamente limitada,

por ejemplo, una empresa.

49. Latencia: lapso necesario para que un

paquete de información viaje desde la fuente hasta su destino. La latencia y el

ancho de banda, juntos, definen la capacidad y la velocidad de una red.

50.

LÓGICA: Es una secuencia de operaciones realizadas por el hardware o por el

software.

51. Mainframe: estructura principal.

Computadora de gran tamaño de tipo multiusuario, utilizada en empresas.

52. Megabit: Aproximadamente 1 millón de

bits. (1.048.576 bits).

53. Megabyte (MB): unidad de medida de una

memoria. 1 megabyte = 1024 kilobytes = 1.048.576 bytes.

54. Megahertz (MHz): Un millón de hertz o

hercios.

55. Memoria caché: pequeña cantidad de

memoria de alta velocidad que incrementa el rendimiento de la computadora

almacenando datos temporariamente.

56. Memoria flash: tipo de memoria que puede

ser borrada y reprogramada en unidades de memoria llamadas "bloques".

Su nombre se debe a que el microchip permite borrar fragmentos de memoria en

una sola acción, o "flash".

57. Microprocesador (microprocessor): es el

chip más importante de una computadora. Su velocidad se mide en MHz.

58. Módem: modulador-demodulador.

Dispositivo periférico que conecta la computadora a la línea telefónica.

59. Motherboard: Placa que contiene los

circuitos impresos básicos de la computadora, la CPU, la memoria RAM y slots en

los que se puede insertar otras placas (de red, de audio, etc.).

60. Network: (red) Una red de computadoras

es un sistema de comunicación de datos que conecta entre si sistemas

informáticos situados en diferentes lugares. Puede estar compuesta por

diferentes combinaciones de diversos tipos de redes.

61. Network Interface Card: Tarjetas

adaptadoras ubicadas dentro de las computadoras que especifican el tipo de red

a utilizar (Ethernet, FDDI, ATM) y que a través de ellas son el vínculo de

conexión entre la computadora y la red. O sea, los cables de la red se conectan

a la computadora.

62. Nanosegundo: una milmillonésima de

segundo. Es una medida común del tiempo de acceso a la memoria RAM.

63. Online: en línea, conectado. Estado en

que se encuentra una computadora cuando se conecta directamente con la red a

través de un dispositivo.

64. OSI (Interconexión de Sistemas

Abiertos): Norma universal para protocolos de comunicación.

65. Página web: una de las páginas que

componen un sitio de la WWW. Un sitio web agrupa un conjunto de páginas afines.

A la página de inicio se la llama "home page".

66. password: contraseña.

67. PCMCIA: Personal Computer Memory Card

International Association.Tarjetas de expansión de memoria que aumentan la

capacidad de almacenamiento.

68. PDF: Portable Document Format. Formato

de archivo que captura un documento impreso y lo reproduce en su apariencia

original. Los archivos PDF se crean con el programa Acrobat.

69. Pixel: combinación de

"picture" y "element". Elemento gráfico mínimo con el que

se componen las imágenes en la pantalla de una computadora.

70. Placa Ethernet: placa que se inserta en

una computadora para conectarla en red con otras a través de un cable.

71. Placa: tarjeta que se inserta en un slot

de la motherboard para expandir la capacidad de una computadora.

72. Plug-in: programa que puede ser

instalado y usado como parte del navegador.

73. Procesador (processor): conjunto de

circuitos lógicos que procesa las instrucciones básicas de una computadora.

74. Puerto: en una computadora, es el lugar

específico de conexión con otro dispositivo, generalmente mediante un enchufe.

Puede tratarse de un puerto serial o de un puerto paralelo.

75. Router – Ruteador: Dispositivo que

dirige el tráfico entre redes y que es capaz de determinar los caminos mas

eficientes, asegurando un alto rendimiento.

76. RAM: Random Acces Memory: Memoria de

acceso aleatorio. Memoria donde la computadora almacena datos que le permiten

al procesador acceder rápidamente al sistema operativo, las aplicaciones y los

datos en uso. Tiene estrecha relación con la velocidad de la computadora. Se

mide en megabytes.

77. Rebutear: volver a cargar el sistema

operativo de una computadora que se ha "colgado".

78. Red: en tecnología de la información,

una red es un conjunto de dos o más computadoras interconectadas.

79. ROM: Read Only Memory: Memoria de sólo

lectura. Memoria incorporada que contiene datos que no pueden ser modificados.

Permite a la computadora arrancar. A diferencia de la RAM, los datos de la

memoria ROM no se pierden al apagar el equipo.

80. Router: ruteador. Sistema constituido

por hardware y software para la transmisión de datos en Internet. El emisor y

el receptor deben utilizar el mismo protocolo.

81. SATA: Serial Advanced

Technology Attachment, interfaz de transferencia de datos

entre la placa base y algunos dispositivos de almacenamiento, como puede ser el disco

duro, lectores y regrabadores de CD/DVD

82. Switch: Un dispositivo de red capaz de

realizar una serie de tareas de administración, incluyendo el

redireccionamiento de los datos.

83. SDRAM: memoria muy rápida, de gran

capacidad, para servidores y estaciones de trabajo.

84. Semiconductor: se llama así a las

sustancias aislantes, como el germanio y el silicio, que se transforman en

conductores por la adición de determinadas impurezas. Los semiconductores

tienen enorme importancia en electrónica.

85. Serial: método para transmitir datos

secuencialmente, es decir, bit por bit.

86. ScanDisk: programa de Windows que revisa

un disco, detecta errores y los corrige.

87. Servidor: computadora central de un

sistema de red que provee servicios y programas a otras computadoras

conectadas. Sistema que proporciona recursos (por ejemplo, servidores de

archivos, servidores de nombres). En Internet este término se utiliza muy a menudo

para designar a aquellos sistemas que proporcionan información a los usuarios

de la red.

88. Slot: ranura de la motherboard que

permite expandir la capacidad de una computadora insertándole placas.

89. S.O. (Sistema Operativo) Programa o conjunto de programas que efectúan la

gestión de los procesos básicos de un sistema informático, y permite la normal

ejecución del resto de las operaciones

90. Software: término general que designa

los diversos tipos de programas usados en computación.

91. SQL: Structured Query Language. Lenguaje

de programación que se utliza para recuperar y actualizar la información

contenida en una base de datos. Fue desarrollado en los años 70 por IBM. Se ha

convertido en un estándar ISO y ANSI.

92. Trascend Networking: Tecnologías de 3Com

para la construcción de grandes redes corporativas. Consiste en tres elementos

principales, rendimiento escalable, alcance extensible y administración del

crecimiento.

93. TCP/IP: Transfer Control Protocol /

Internet Protocol. Es el protocolo que se utiliza en Internet.

94. Unix: sistema operativo multiusuario,

fue muy importante en el desarrollo de Internet.

95. USB (Universal Serial Bus): es una

interfase de tipo plug & play entre una computadora y ciertos dispositivos,

por ejemplo, teclados, teléfonos, escáners e impresoras.

96. Virus: pequeño programa que

"infecta" una computadora; puede causar efectos indeseables y hasta

daños irreparables.

97. WAN- Wide Area Network: Red de área

amplia: Una red generalmente construida con líneas en serie que se extiende a

distancias mayores a un kilómetro.

98. WAP (Wireless Application Protocol):

norma internacional para aplicaciones que utilizan la comunicación inalámbrica,

por ejemplo el acceso a Internet desde un teléfono celular.

99. webmail: servicio que ofrecen ciertos

sitio web para crear una cuenta gratuita de e-mail. Mediante el webmail el

correo electrónico se revisa con el navegador. Se puede acceder a él desde

cualquier computadora situada en cualquier lugar.

100. WinZip: programa de Windows que permite

comprimir archivos.

Les dejo un pequeño mapa conceptual para darse una idea de como el computador se divide.

Suscribirse a:

Entradas (Atom)